ChatGPT demokratyzuje hakowanie – czy można to powstrzymać?

W listopadzie 2022 r. OpenAI wypuściła na rynek nowy model sztucznej inteligencji o nazwie ChatGPT (Generative Pre-Training Transformer) – umożliwiając ludziom zadawanie pytań i otrzymywanie odpowiedzi. Technologia stała się niezwykle popularna, zdobywając ponad milion użytkowników w ciągu pięciu dni od jego uruchomienia. Wiele osób używało jej do pisania poezji lub tworzenia nowych przepisów. Ale inni mieli bardziej nikczemne pomysły. Eksperci szybko odkryli, że przestępcy używają ChatGPT do tworzenia złośliwych wiadomości e-mail i kodu, które można wykorzystać do hakowania organizacji. I w rzeczywistości - zaledwie kilka tygodni od jego wydania – ChatGPT jest już używany do tego właśnie celu. Zasadniczo jest to demokratyzacja hakowania — umożliwianie nawet nowicjuszom tworzenia złośliwych plików i narażanie nas wszystkich na ryzyko.

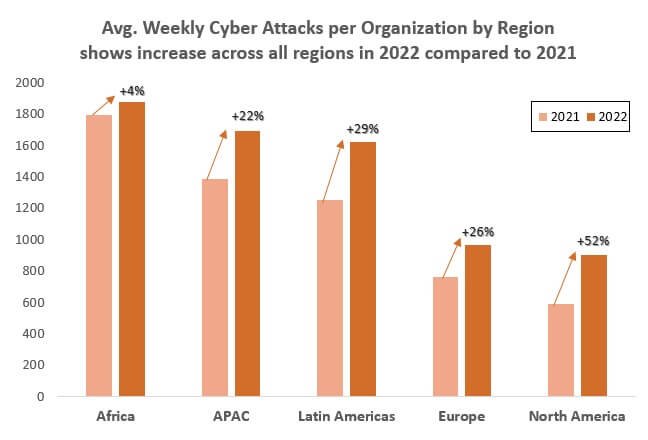

Dlaczego to ma znaczenie? Świat doświadczył 38 % wzrostu cyberataków w 2022 roku (w porównaniu do 2021 roku). Przeciętna organizacja była atakowana 1168 razy tygodniowo. Edukacja i opieka zdrowotna były dwiema najbardziej atakowanymi branżami, co spowodowało przestój w szpitalach i szkołach. Lekarze nie byli w stanie leczyć pacjentów, a szkoły zamknięto, a dzieci odesłano do domu. Niestety, teraz jesteśmy świadkami wzrostu cyberataków z powodu ChatGPT i innych generatywnych modeli sztucznej inteligencji.

OpenAI dokłada starań, aby powstrzymać nadużywanie swojej technologii AI, pisząc: „Chociaż dołożyliśmy starań, aby model odrzucał nieodpowiednie żądania, czasami będzie reagował na szkodliwe instrukcje lub zachowywał się stronniczo”. Ale niestety ChatGPT zmaga się powstrzymywaniem generowania niebezpiecznego kodu.

Zespół ekspertów Check Point Research odkrył, że niektórzy cyberprzestępcy wykorzystują ChatGPT do tworzenia złośliwych narzędzi – w niektórych przypadkach hakerzy całkowicie polegali na sztucznej inteligencji, podczas gdy inni po prostu używali sztucznej inteligencji do znacznego skrócenia czasu pisania złośliwego kodu. Od złośliwego oprogramowania, przez phishing, aż po skrypt, który może automatycznie zaszyfrować narzędzie ofiary bez interakcji użytkownika — z niepokojem obserwuje się, jak szybko cyberprzestępcy używają ChatGPT w środowisku naturalnym do swoich destrukcyjnych celów.

W tym miesiącu na dorocznym spotkaniu World Economic Forum mamy okazję, by liderzy z obszaru rządowego, sztucznej inteligencji, biznesu i cyberbezpieczeństwa spotkali się i pilnie omówili skrzyżowanie sztucznej inteligencji, cyberbezpieczeństwa i ogólnego bezpieczeństwa. Nie powinniśmy dążyć do tłumienia innowacji, ale raczej do zapewnienia bezpiecznych warunków ich wdrożenia. Razem z pewnością możemy stawić czoła temu zagrożeniu dla bezpieczeństwa publicznego, infrastruktury krytycznej i naszego świata.